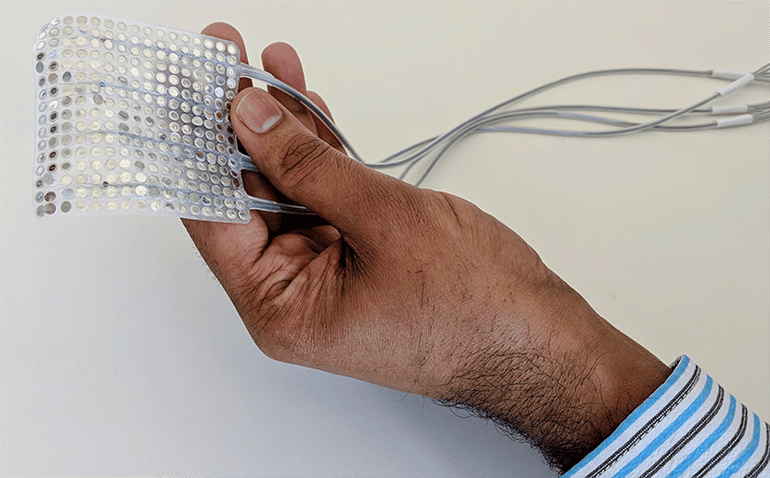

旧金山大学的研究人员开发了一种神经接口,允许患者在不使用语音的情况下通过该设备“说话”。

这是神经修复领域的一个里程碑:该系统监控大脑活动并使用人工语音(例如谷歌或亚马逊语音助手的语音助手)将其转换为单词。该软件非常先进,包括对喉部、舌头、嘴唇和下巴的精确虚拟重建。

为什么我们迷失方向?

患者因多种原因失去说话能力:退行性疾病、事故或脑损伤。已经使用的技术允许一些人通过“翻译”微小的面部动作或使用其他机制来发音几个单词,这在任何情况下都会使沟通变得非常漫长和费力。

旧金山研究的神经接口使用“模仿”语音中心协调声道运动方式的基础设施,直接将大脑活动转化为自然的语音。

“声道的运动和单词的声音之间的关系非常复杂,” 骰子 戈帕拉·阿努曼奇帕利(Gopala Anumanchipalli),是参与该项目的研究人员之一。 “我们认为,如果这些语言中心对动作进行编码并以某种方式翻译它们,我们也可以从大脑信号开始执行此操作”.

它由什么组成?

为此,团队创建了一个“虚拟”声道,利用机器学习逐渐产生越来越正确的声音。 一组志愿者发出特定的句子,同时监测他们的大脑活动:使用的人工智能扫描这些信号并将它们与声道的运动进行比较,以准确了解它们如何转化为特定的声音。

“我们有能力完美模仿口语,” 骰子 Josh Chartier,另一位研究人员。 “对于较慢或较柔和的声音(例如“sh”或“z”),我们已经处于非常先进的阶段,但我们在处理“b”和“p”等截断的声音方面遇到了困难。然而,由于机器学习的使用,准确性水平以惊人的速度提高。”

“无法移动手臂和腿的人已经学会用大脑控制机器人假肢,” 沙蒂尔继续。 “我们相信有一天,有言语障碍的人将通过这种语音假肢再次学会说话。”

发表于《自然》