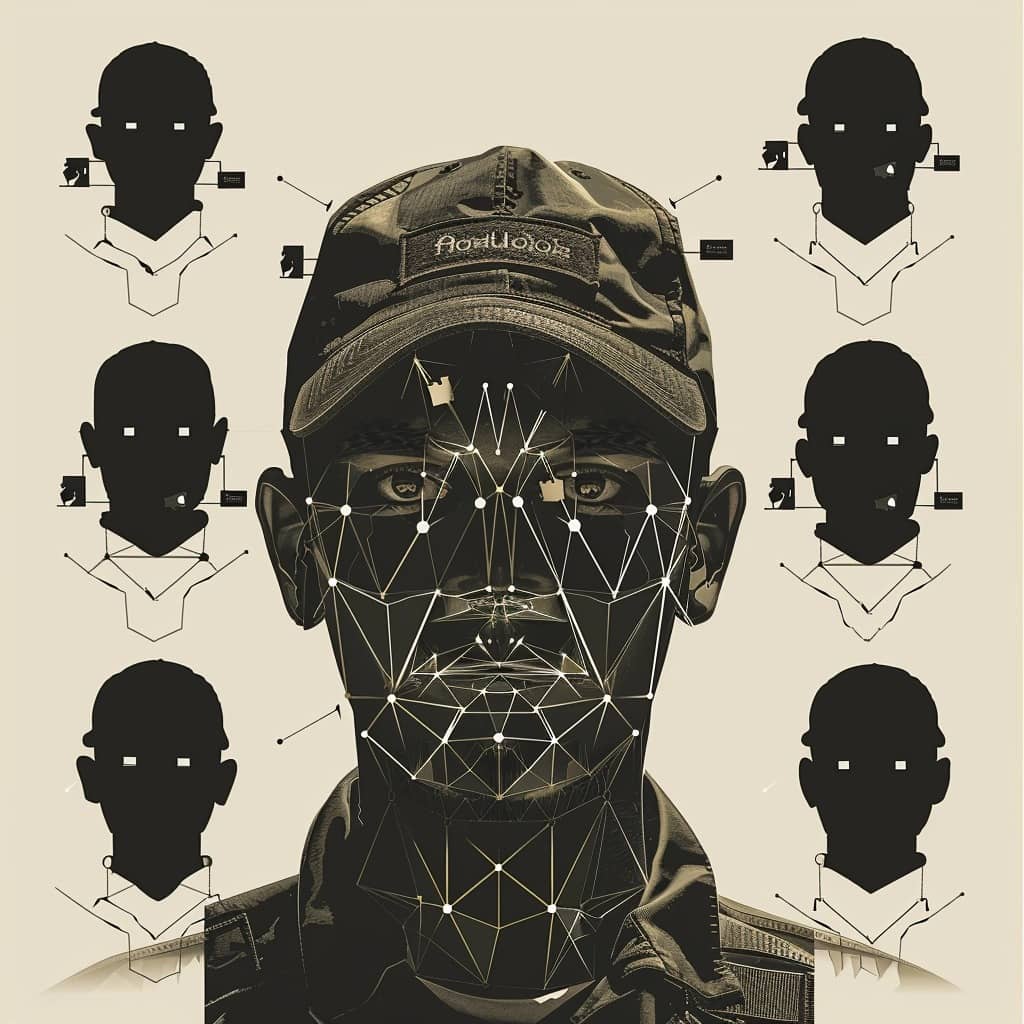

面部识别技术可以成为确保安全的有力工具,但如果以不透明和歧视性的方式使用,也会成为危险的武器。加沙地带发生的事情就证明了这一点,在 7 月 XNUMX 日发生残暴和野蛮的袭击之后,以色列悄悄对巴勒斯坦人实施了大规模的生物识别监视计划。利用以下算法 谷歌图片 和启动 科视,以色列军队在未经同意的情况下对数千人进行了分析,这似乎是一个令人不安的高科技种族分析案例。

加沙的老大哥

故事, 据《纽约时报》报道,具有反乌托邦惊悚片的轮廓。 7 月 8200 日袭击事件发生后,以色列军队 XNUMX 部队(主要情报单位)开始通过分析哈马斯在社交媒体上发布的监控摄像头图像和视频来识别潜在嫌疑人。与此同时,士兵审问巴勒斯坦囚犯,以确认他们是否属于哈马斯所属社区。

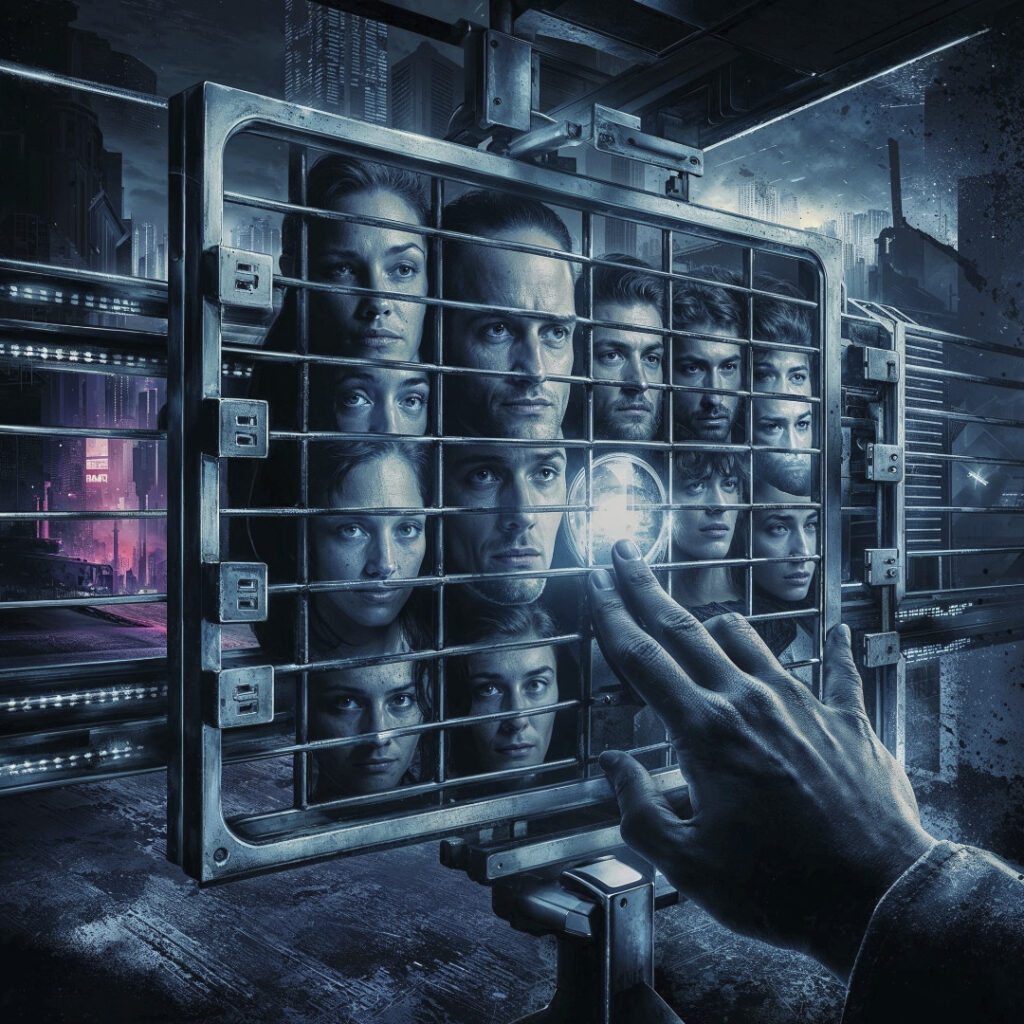

有了这些材料,启动 科视 (该公司拥有能够识别面部的系统,即使面部可见度低于 50%)也为在加沙工作的以色列官员建立了一个临时面部识别工具。为了进一步充实数据库并寻找其他目标,军方在巴勒斯坦人逃往南部的主要道路上安装了配备生物识别摄像头的检查站。一位官员向《泰晤士报》透露,其目标是创建一份 7 月 XNUMX 日袭击参与者的“黑名单”。实际上,这是基于算法和种族分析的“常见嫌疑人”档案。这是一次高科技搜捕,在相关人员不知情和同意的情况下进行。 奥威尔式的噩梦成真了。

以色列,错误和滥用行为

正如我们所知,技术并非绝对可靠。 尤其是当它基于颗粒状图像或部分覆盖的面部时。这也是欧洲对面部识别采取谨慎态度的原因。以色列士兵自己也向《泰晤士报》承认,Corsight 的系统并不总是准确的。他有时会错误地认定人们与哈马斯有关联。这就是巴勒斯坦诗人的情况 莫萨布·阿布·托哈11 月中旬,当他试图与家人一起离开加沙前往埃及时,他被以色列检查站接走。他已经被AI通缉了。结果:两天的拘留、殴打和审讯,然后被送回加沙。 连解释都没有。

谁知道还有多少无辜者可能会遭遇这样的命运,仅仅因为他们的种族或居住地而被贴上潜在恐怖分子的标签。面部识别系统固有的风险,如果不谨慎和透明地使用,可能会放大人类的偏见。

谷歌,大耳朵

但这个监视计划背后的不仅仅是 Corsight。士兵们向《泰晤士报》透露,以色列军队已将该公司的技术与另一种更容易使用、甚至更强大的工具相结合: 谷歌照片。 情报官员将“已知人物”数据库上传到 Big G 的服务器,并使用图像搜索功能来识别其他嫌疑人。一名士兵观察到,Google Photos 甚至能够从最小的细节中识别人脸,超越了包括 Corsight 在内的其他应用程序。

简而言之,这个山景城巨头也许在不知情的情况下,已经成为以色列控制加沙机器的关键齿轮。一只伟大的耳朵能够绘制和监视整个人口,以国家安全的名义侵犯他们的隐私和权利。对人工智能的使用存在争议且不透明,在加沙,人工智能的使用与 其他先进技术,例如机器人和无人机,并提出了有关大型科技公司道德责任的问题。

不仅仅是以色列:监视的阴暗面

不幸的是,加沙的例子并不是孤立的。科赛特成立 在2019 获得加拿大基金Awz Ventures 5万美元投资,专门提供面部识别解决方案。对于很多现实:政府、执法部门和军队。 在2020创建仅一年后,该公司就宣称可以识别蒙面面孔。 两年后,即2023年, 宣布正在开发一种能够根据 DNA 重建人特征的工具(我们在这里谈论它). 在2023,与波哥大警方合作追查公共交通上的谋杀和盗窃嫌疑人。

这是一项不断增长的业务,受到恐惧言论和对安全的渴望的推动,但并非没有灰色地带。 只要想想以下的陈述 亚伦·阿什肯纳兹,Awz Ventures 的执行合伙人, 去年十月《耶路撒冷邮报》的一篇社论 他写道,他的基金正在为以色列提供“阻止这些邪恶恐怖分子前进的技术工具”。很容易想象这些工具是什么。

站在大哥一边

更一般地说,Corsight 和其他类似公司的使命似乎是为全球老大哥服务。努力让每一张脸都可追踪、可编目和可监视,在这个世界上,匿名是我们无法承受的奢侈品,而隐私是一种可以在国防祭坛上牺牲的选择。

因此,近几个月来以色列的一些医院也 已开始使用 Corsight 算法 据《福布斯》报道,识别毁容患者。这显然是一种人道主义应用,但却为这种侵入性技术的更多可疑用途铺平了道路。正如加沙事件所表明的那样,风险在于面部识别系统落入坏人手中成为压迫和歧视的工具。他们将安全权转变为侵犯其他基本权利的借口,首先是匿名权或公平审判权。让我们明确一点:这并不是要妖魔化面部识别本身,面部识别可以在从医疗保健到安全的各个领域产生积极的应用。但要以明确和民主的方式规范其使用,限制其潜在的扭曲和滥用。

这将人们减少到像素和百分比,并根据肤色、面部特征或社会背景对他们进行标记。这场噩梦肯定会让人质疑那些开发和销售这些技术的人的责任,当然也让人质疑那些购买和使用这些技术的人的责任。