似乎 2020 年的灾难还不够严重,由学者、政策专家和人工智能内部人士组成的团队警告我们即将出现麻烦。 18,准确地说。这些是我们在未来 15 年应该担心的主要人工智能威胁。

科幻小说和大众文化希望我们相信,我们的消亡将源于智能机器人的骚乱。 其实一个 最近的研究 《犯罪科学》(Criminal Science)中的文章揭示了,与人工智能本身相比,最严重的威胁与我们有更多关系。

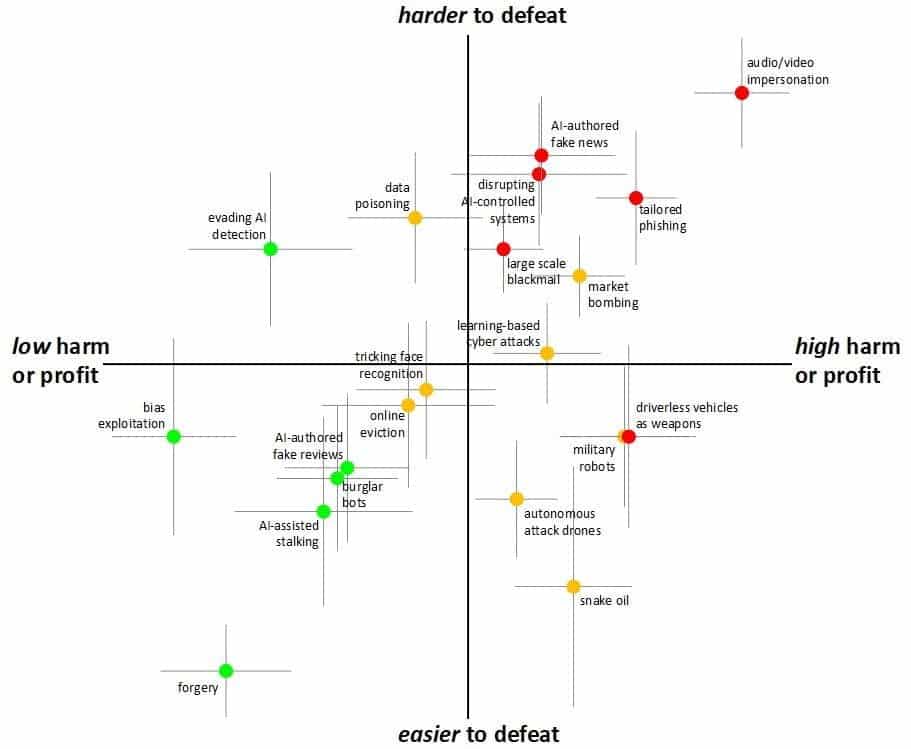

通过根据潜在危害,盈利能力,生存能力和失败程度评估威胁,该小组确定了 deepfake,一种已经存在并且正在传播的技术, 代表最高威胁级别。

Deepfake,头号敌人

机器人起义和 Deepfake 技术之间存在根本区别。第一个可能会造成物质损失。第二个是系统性的:它可能会导致人们和社会本身的信任受到侵蚀。

最严重的人工智能威胁似乎总是遥远的未来。 毕竟,当 Alexa 今天甚至无法正确设置面食计时器时,人工智能怎么能伤害我们呢? 肖恩·约翰逊资助这项研究的伦敦大学学院道斯未来犯罪中心主任解释说,这些威胁将变得越来越复杂,并与我们的日常生活交织在一起。

“我们生活在一个不断变化的世界,这个世界创造了新的机会,无论好坏,” 约翰逊警告说。 “这使得预测未来的犯罪威胁成为当务之急,以便政策制定者和其他拥有行动专业知识的人可以在严重问题发生之前采取行动。”

作者承认,这项研究中表达的判断本质上是推测性的,并且受我们当前的政治和技术环境的影响,但是这些技术的未来不可忽视。

最严重威胁的“播放列表”是如何诞生的

为了制定对未来的预测,研究人员召集了一个由14名相关领域的学者,10名私营部门专家和XNUMX名公共部门专家组成的团队。

然后,这些专家被分为四到六人一组,并给出了人工智能可能产生的潜在问题清单。场景范围从物理威胁(自主无人机攻击)到网络钓鱼等数字形式的威胁。

为了做出判断,团队考虑了攻击的四个主要特征:

潜在损害

盈利能力

可行性

漏洞

对于专家来说,deepfake的破坏将是物质,精神甚至社会的。 它们还可能损害其他人工智能(例如,通过逃避面部识别)或成为间接结果(例如,使用Deepfake视频勒索人们)。

虽然这些因素无法真正相互分离(例如,攻击的危害实际上可能取决于其可行性),但专家们被要求单独考虑这些标准的影响。

然后对各个专家组的分数进行排名,以确定未来 15 年内我们可能通过人工智能(或由人工智能)看到的总体最具破坏性的攻击。

宠坏了选择

如上所述,通过比较18种不同类型的AI威胁,该小组确定Deepfake形式的视频和音频操纵是有史以来最严重的威胁。

“人类有一种强烈的倾向,相信自己的眼睛和耳朵。这就是为什么音频和视频证据传统上被赋予很大的可信度(并且通常具有法律价值),尽管照片欺骗的历史由来已久,”作者解释道。 “但深度学习(和深度伪造)的最新发展大大增加了生成虚假内容的机会。”

这些操作的潜在影响?

从通过假扮家庭成员向老人骗人的个人到旨在播撒公众和政府人物不信任感的视频。 个人难以察觉(甚至在某些情况下甚至是专家)并且难以制止的攻击。

其他主要威胁包括用作遥控武器的自动驾驶汽车。 有趣的是,该小组将机器人机器人(可以爬过水槽窃取钥匙或为盗贼打开门的小型机器人)视为最危险的威胁之一。

最严重的人工智能威胁。那么我们就完了吗?

不,但是我们必须努力。 在我们乐观的图像中,有某种按钮可以阻止所有机器人和所有邪恶的计算机。

实际上,威胁本身并没有那么多。 这是我们使用它们来操纵和伤害彼此的方式。