Nvidia公司征服了人工智能世界的GPU巨头,丝毫没有放缓的迹象。相反, 与演示文稿 的新 布莱克韦尔 B200 GPU 和GB200“超级芯片”,似乎有意进一步扩大其在竞争中的领先地位。

这些计算能力的怪物, 性能比已经令人印象深刻的 H30 高出 100 倍,承诺重新定义人工智能的视野,并巩固 Nvidia 在战略和竞争日益激烈的领域的主导地位。

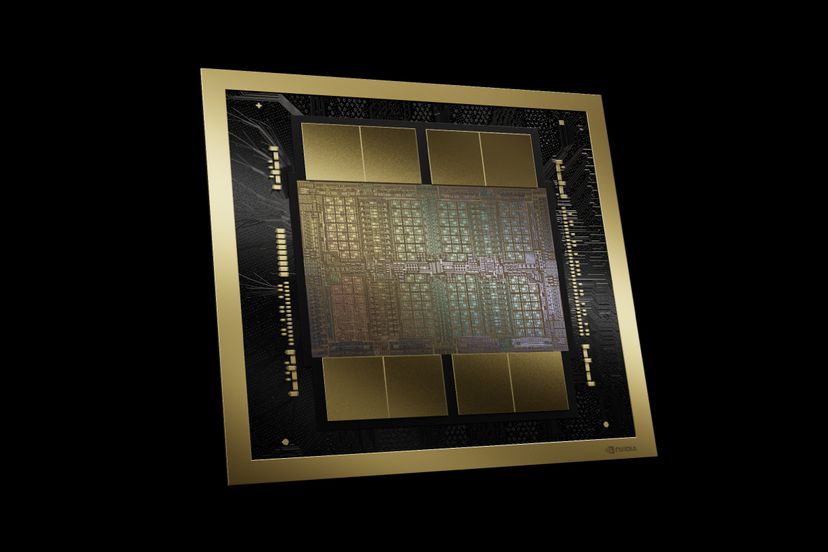

Blackwell B200、208 亿个晶体管和 20 petaflops 的纯功率

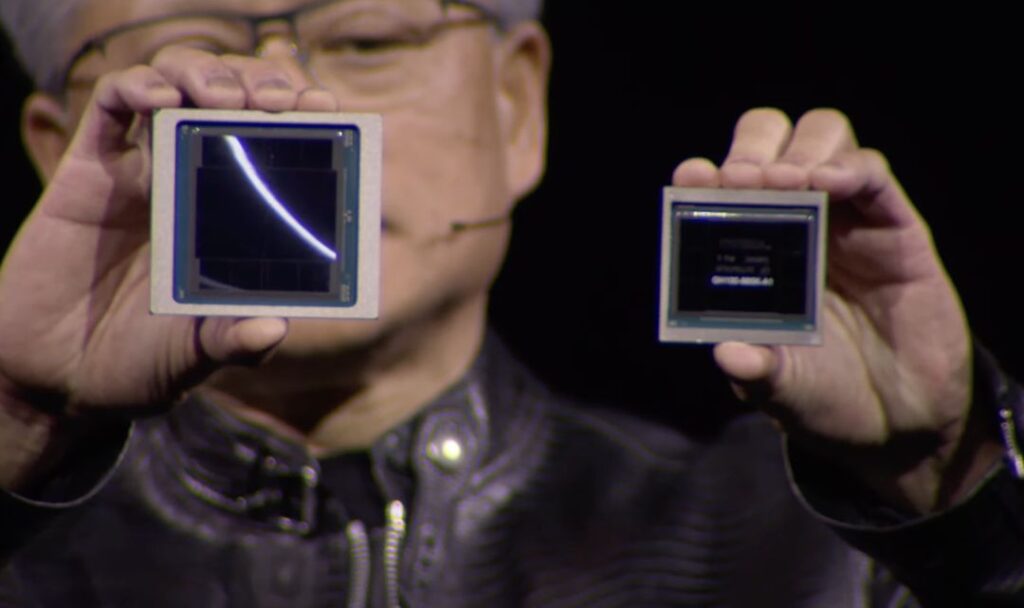

这些数字让你头晕目眩。 全新 B200 GPU 将多达 208 亿个晶体管(是的,你没有看错,是数十亿个)封装到单个芯片中,释放高达 20 petaflops 的 4 位浮点 (FP4) 计算能力。给你一个想法,这是一种可以与 20万台高端笔记本电脑。 所有这些都集成在明信片大小的单个芯片中。

但 Nvidia 真正的王牌是 Blackwell GB200,这是一种“超级芯片”,将两个 B200 GPU 和一个 Grace CPU 融合在一个封装中。这款 30 petaflops 的怪兽有望在大型语言模型 (LLM) 推理任务上提供 H30 高达 100 倍的性能,同时成本和功耗降低 25%。 简而言之: 更多的电力、更少的费用、更少的环境影响。 是的,有7个字。

当一颗芯片不够用时,“变压器引擎”就会来处理它

Nvidia 如何发挥如此强大的能力?其中一个秘密在于第二代“变压器引擎”:一种专用架构,可以使计算能力加倍,在更小的空间中放置更多的神经元,从而实现越来越大、越来越高性能的神经网络。

当您将数十或数百个这样的芯片放在服务器中时会发生什么?多达 576 个 GPU 可以以每秒 1,8 TB 的双向带宽相互“对话”。 简而言之(我发誓,这一次是真的): 极端并行计算。

从芯片到超级计算机,仅一步之遥

如果您想了解我们即将看到的情况,由这些 Blackwell 驱动的系统将能够训练具有 27 万亿个参数的模型。 GPT-4 号称“仅仅”1,7 万亿。

Nvidia似乎正在向整个AI世界发起挑战:你想走得快吗?跟着我们。大型云厂商似乎已经抓住了这一信息:亚马逊、谷歌、微软和甲骨文已经排队在他们的服务中提供这些小玩意。这表明对计算能力的渴望比以往任何时候都更加强烈。

有了 Blackwell,Nvidia 会扼杀市场吗?

有些人对英伟达的过度权力嗤之以鼻,因为这有可能在人工智能等关键领域造成事实上的垄断。提出这个问题是件好事。有人担心,这场“更大、更快、更强大”的竞赛可能会导致日益复杂和不可预测的人工智能系统不受控制地发展。这也是一个合理的问题。

因为除了这些问号之外,Nvidia 还通过 Blackwell 和 GB200 证明了它已经踩在了创新的加速器上。坏的。而且我无意删除它。

不管你喜欢与否,人工智能的未来越来越多地采用 GPU 语言。还有黄仁勋那张狡猾的脸。