上周我们解决了恐慌问题 媒体关于人工智能的诱导。我告诉你们,就像任何其他方式一样,否认对这项可以彻底改变我们社会的技术的机会和风险进行健康的辩论。显然还有硬币的另一面:一大群科学家根本不关心可能的危险。对还是错?

因为有人视而不见

“你有没有想过人工智能会导致人类的终结?”。最近在白宫举行的新闻发布会上,发言人 卡琳·让-皮埃尔 他笑了 面对这个问题。可惜答案是严肃的“不”。尽管人工智能先驱如 阿兰·图灵 尽管已经警告过“机器接管”的风险,但目前的许多研究人员似乎根本不在乎。然而,人工智能正在以令人难以置信的速度发展。 那他们为什么不多讨论一下呢?

大卫·克鲁格剑桥大学工程系教授声称,原因首先是文化和历史。在对这些技术(乌托邦或反乌托邦)抱有过度和理想主义期望的各个阶段之后,研究人员决定继续实践。因此,他们专注于自动驾驶等特定领域,并停下来询问有关长期影响的问题。

他们做得好还是不好? 如果风险是真实的怎么办?

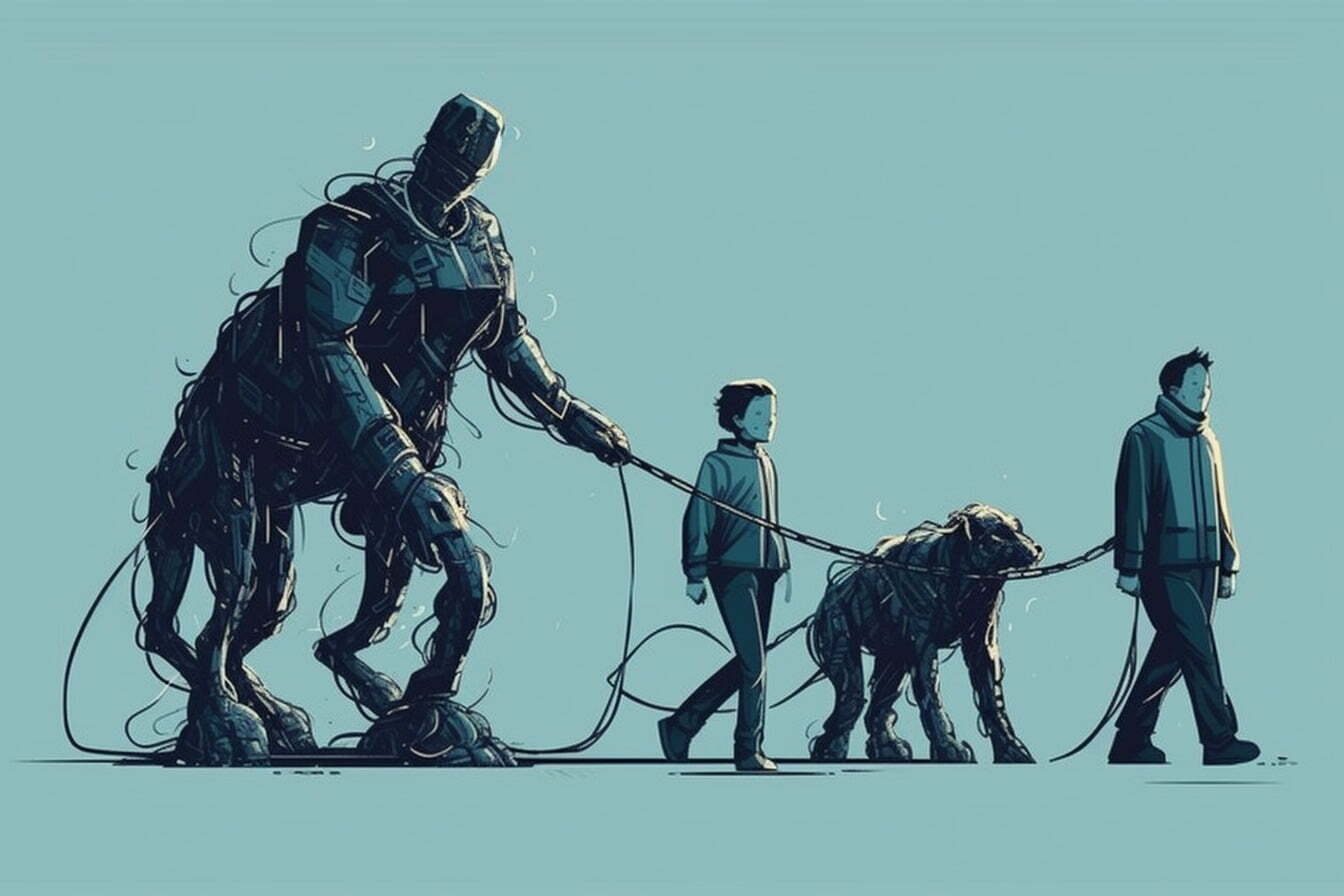

“忧虑者”(请注意,与“灾难论者”是一个非常不同的类别)的基本论点是人工智能与人类之间的类比。正如人类为了争夺资源而消灭了其他物种一样,人工智能也可以对我们做同样的事情。换句话说,它可以取代我们。经济上和政治上。身体上。

这些主题听起来宏大,几乎是科幻小说。事实上,人工智能的风险常常被忽视,正是因为它们被认为“不科学”。然而,这并不能成为缺乏关注的理由。相反,我们应该像处理其他复杂的社会问题一样处理这些问题。这里一个关键因素发挥了作用:融资。大多数人工智能研究人员都从科技巨头那里获得资金,这可能会产生利益冲突,从而影响专家处理人工智能相关问题的方式,从而导致否认风险而不是对风险进行客观评估。

因此,在引导金融和媒体最喜欢的做法(分而治之)中,舆论不应该“倾向于”两个极点之一,而应该向前看,或者更应该向内看。事物内部,要求对主题进行深入探讨。

是时候认真起来了

与偏见和假新闻等紧迫问题相比,人工智能的存在风险可能更多是猜测性的,而不是真实的,但基本的解决方案是相同的:监管。现在是开始激烈的公开辩论并解决与人工智能相关的道德问题的时候了。其他一切都是无聊,或者更确切地说,无聊。

因为我们知道:我们不能忽视人工智能对人类的潜在风险。考虑到利益冲突和道德责任的公开和诚实的公开辩论至关重要。只有这样,我们才能了解白宫发言人的笑声是否真正恰当,或者相反,这是危险的集体无意识的表现。