第二 最新报告 在联合国关于利比亚内战的报告中,即将结束的一年首次出现了自主武器系统、杀手机器人杀人事件。将来我们可以将其视为新军备竞赛的起点,这可能会严重伤害我们。

最近几天(13月17日至XNUMX日)La 联合国特定常规武器公约 就这个问题会面,就像每五年发生一次一样。 自 1983 年以来,该大会选择限制一些残忍的武器,例如杀伤人员地雷。 这一次,他讨论了可能禁止这些自主武器的问题。 并且还没有达成共识来限制它们。

这可能是一个灾难性的错误。

自主武器系统是杀手机器人。在这篇文章中,你总会听到我这样称呼它们:杀手机器人。因为这就是我。带有可以单独运行的武器的系统。系统是为战争而设计的,是为了杀人。全球各国政府都在大力投资这一趋势。

另一方面,显然,人道主义组织(其中一个,停止杀手机器人, 你在这里找到)致力于要求制定这些武器的开发规则和禁令。他们做得很好。如果我们不限制自主武器的使用,结局将会非常糟糕。该领域的颠覆性技术将破坏所有军事战略的稳定,增加先发制人攻击的风险。 包括化学的、生物的、核的。

鉴于杀手机器人的发展速度,刚刚结束的联合国会议可能已经 最后一次 以避免新的军备竞赛。或者最后一张。

当谈到杀手机器人系统时,任何人都可以看到四种危险。

杀手机器人的第一个问题: 鉴别。

自主武器总能区分敌对士兵和拿着玩具枪的孩子吗?单个人为错误(这也是可能的)与算法的错误设置之间的差异可能会使问题达到令人难以置信的规模。一位自主武器专家称 保罗·沙尔 使用一个比喻:即使您的手指离开扳机,仍会继续开火的有故障的机枪。 并射击直到弹药用完,因为它只是一台机器。 他不知道自己在犯错。

不管别人怎么说,人工智能还没有自己的道德(他可能永远不会拥有它,他永远无法学习它).

问题不仅如此 甚至 AI 也是错误的,例如当它认识到哮喘是一个因素时 从而降低患肺炎的风险,或者当它识别有色人种时 像大猩猩。只是当它犯了错误的时候,无论是谁创造了它,都不知道它为什么会犯错,也不知道如何去纠正它。因此我认为杀手机器人不可能以任何“道德”标准来发展。

杀手机器人的第二个问题:低端扩散。

正在开发自主武器的武装部队认为他们将能够遏制和控制它们。你听说过比这更愚蠢的想法吗?如果说武器技术的历史告诉我们一件事,那么只有一件事,那就是武器的传播。同样在这种情况下 这是非常可预测的。

卡辛科夫(Kashinkov)突击步枪的过去发生的事情已经变得如此容易,以至于最终落入任何人的手中,杀手机器人也可以重蹈覆辙。市场压力可能会导致高效、廉价且几乎无法阻止的自主武器的诞生。最重要的是:广泛传播。落入政府、疯马、有组织犯罪或恐怖组织手中。

它可能已经发生了。 这 卡古2由土耳其国防承包商制造,是无人机和炸弹的结合体。它具有人工智能来寻找和跟踪目标。它是一款杀手机器人,已经在利比亚内战战场上自主行动,攻击人类。

杀手机器人的第三个问题:高端扩散。

如果我们再考虑“高端”风险,我们就会想到泽尼特。各国可以竞相开发更具破坏性的自主武器,包括那些能够 安装化学、生物、放射性和核武器 。枪支使用率的上升会加剧枪支杀伤力上升的道德危险。

当然,这些杀手机器人很可能会配备昂贵的机器人 道德控制者 旨在最大限度地减少附带损害,追逐“外科手术”攻击的神话。简而言之,好东西只是为了公众舆论。事实是,自主武器甚至会改变你在计划战争之前所做的最平庸的成本效益分析。它们将是具有致命风险的骰子,投掷时无需担心。

缺乏竞争技术的国家在地面上发动的不对称战争将变得更加普遍。 非常普遍的不稳定。

第四个也是最后一个问题:战争法

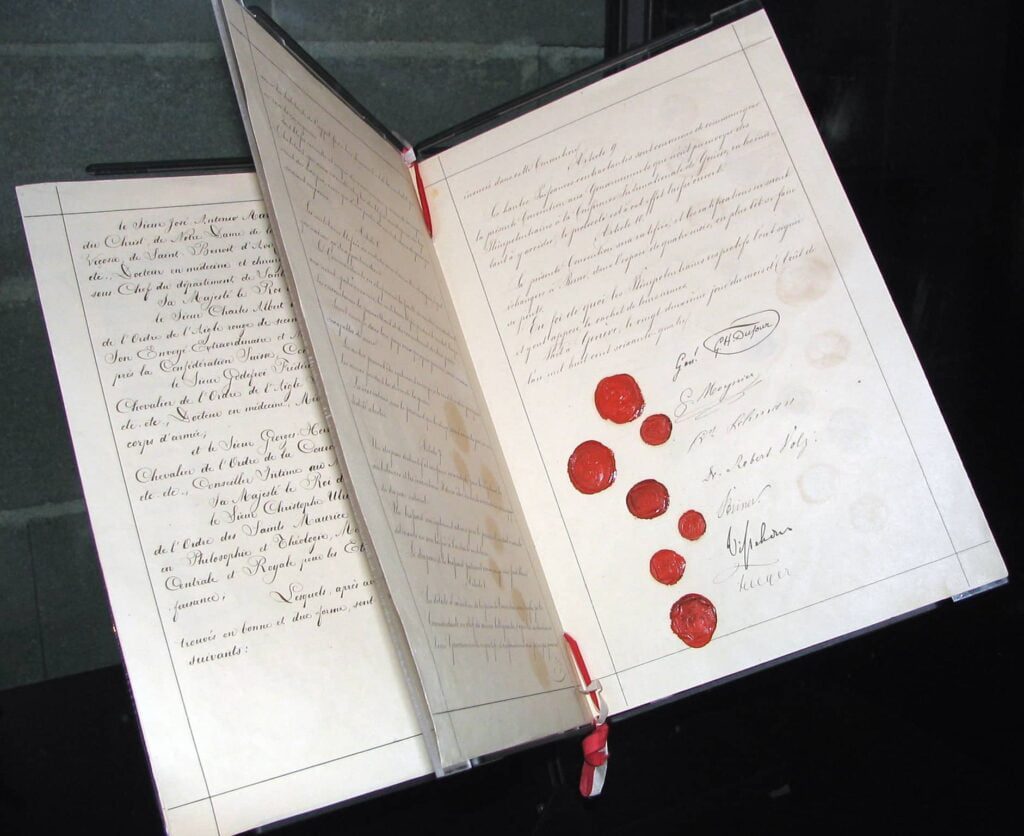

杀手机器人(如果它们肯定会扩散的话)将破坏人类对战争罪行和暴行的最后一个姑息疗法:国际战争法。这些法律从一开始就编入条约 吉内夫拉会议,它们是将战争与我难以想象的更糟糕事物区分开来的细线。

战争法是根本性的,因为它们也将责任强加给参战者。斯洛博丹·米洛舍维奇是一个国家的总统,必须为自己的行为负责。他在联合国前南斯拉夫问题国际刑事法庭受审 他必须为自己的所作所为负责。

现在?杀手机器人是否犯有战争罪?谁被起诉?武器?战士?士兵的指挥官?制造武器的公司?非政府组织和国际法专家担心自主武器会导致严重的后果 责任缺口 .

必须证明一名士兵使用自主武器犯罪。为此,必须证明该士兵犯下了有罪行为,并且有这样做的具体意图。在杀手机器人的世界里,这是一个相当复杂的动态。

杀手机器人的世界是一个没有规则的世界 显着的人为控制 在武器上。 这是一个将犯下战争罪行而无需追究战争罪犯责任的世界。 战争法的结构及其威慑价值将被大大削弱。

一场新的全球军备竞赛

想象一下,每个人都可以在他们想要的时候使用他们想要的所有力量。 对任何人的后果都更少。 想象一个星球,在这个星球上,国家和国际军队、叛乱团体和恐怖分子可以在他们选择的时间和地点以理论上零风险部署理论上无限的致命力量,而无需承担由此产生的法律责任。